【Moontalk深度個股分析】AMD 與 CPU 復興: 重新理解 AMD 的價值重估

從 Token Economics、Inference 架構到 x86 生態,市場開始重新定價 AMD。這場 AI 基礎設施重估能走多遠?

摘要:

在過去短短一個月內,AMD (Advanced Micro Devices) 的股價暴漲超過 80%,這與CPU 價值重估有重大關連。Moon在上月頭也曾寫過關於CPU的產業分析,有興趣的朋友也可以看看。

回歸主題,今天的主角是AMD。

自 2023 年生成式 AI 爆發以來,市場的聚光燈幾乎全部打在 Nvidia 身上。在那個被「Training(模型訓練)」主導的時代,GPU 是唯一的王者,是算力軍備競賽的絕對核心。而 AMD,在多數投資者眼中,僅僅是一個「Nvidia 的次級替代品」,一個在 GPU 產能受限時的備胎,一個在 CUDA 生態護城河外掙扎的挑戰者。其股價波動,更多地與 PC 和遊戲主機的消費週期緊密相連。

然而,時間來到 2026 年 ,遊戲規則改變了。AI 的故事主軸已經正式從「Training(訓練)」跨越到了「Inference(推論)」,更準確地說,是進入了「Agentic AI(代理式 AI)」的時代。在這個新紀元裡,AI 不再只是被動回答問題的聊天機器人,而是能夠自主規劃、調用工具、跨系統協作並執行複雜任務的「數位代理人」。它們是數位世界裡的自主勞動力,能夠處理從預訂旅行、管理電郵到編寫和調試複雜軟體的所有事務。

當 AI 模型需要頻繁地進行邏輯路由(Routing)、工具調用(Tool Calling)、記憶體管理(Memory Management)與上下文處理(Context Handling)時,GPU 那強大的平行矩陣運算能力反而顯得無用武之地。這時候,負責序列邏輯、系統調度與整體協奏的 CPU (Central Processing Unit),重新回到了舞台中央。

今天將深入探討核心問題:AMD 是否已經成為 Agentic AI 時代不可或缺的核心運算基礎設施公司? 市場過去究竟錯看了什麼?這波由 Agentic AI 驅動的 CPU 復興週期,其底層的技術邏輯、經濟模型與市場動態為何?而這場變革,又將把 AMD 推向何方?

一、前情提要:活在 Nvidia 陰影下的週期性配角

為更好地分析AMD和理解今天 AMD 的暴漲,我們可以先來個簡單的前情回顧,剖析市場在過去三年對 AMD 根深蒂固的想法。在華爾街的傳統定價模型中,AMD 的 AI 敘事始終帶有一絲「委曲求全」的色彩,其估值被多重枷鎖束縛。

1. GPU 效能與 Nvidia強勁的CUDA 生態

過去,市場普遍認為 AI GPU 市場是由 Nvidia 實質壟斷的。儘管 AMD 陸續推出了 MI250、MI300X 等產品,但在多數機構投資者的眼中,AMD 的硬體效能或許能追上,但其軟體生態(ROCm)與 Nvidia 經營十多年的 CUDA 相比,仍有著難以跨越的鴻溝。開發者習慣、函式庫完整性、框架支援度,CUDA 像一道無形的牆,將 AMD 隔絕在主流 AI 開發社群之外。因此,市場將 AMD 定位為「第二供應源」,認為只有在 Nvidia H100/B200 缺貨或定價過高時,Hyperscalers才會出於供應鏈多元化和議價目的而勉強採用 AMD 的方案。

2. CPU 被視為 AI 時代的「夕陽資產」

這是市場最大的誤判之一。在 LLM訓練的狂熱期,資金瘋狂湧入 GPU。伺服器架構的討論中,CPU 被邊緣化,甚至被戲稱為「只是用來啟動作業系統和給 GPU 餵數據的資料搬運工」。許多分析師在建立模型時,認為 CPU 的 TAM(總潛在市場)在 AI 時代成長極其有限,甚至會因為企業 IT 預算被 GPU 排擠而面臨萎縮。這種觀點忽略了 AI 工作負載的複雜性,將所有運算任務粗暴地等同於 GPU 擅長的矩陣運算。

圖1:AMD 相對於 NVDA/AVGO/MRVL 過去的本益比(P/E)交易溢價比較。AMD 的估值受到壓抑,反映出市場將其視為「次級替代品」和「週期股」的想法。

3. 難以擺脫的「週期性半導體」標籤

在 2024-2025 年間,當我們翻開多數機構的 AMD 研究報告,除了討論 Datacenter GPU 的進展外,極大篇幅仍停留在 PC 週期(Client)、遊戲主機週期(Gaming)以及嵌入式系統(Embedded)的庫存去化。市場將 AMD 視為一家高度受制於總體經濟與消費性電子週期的傳統半導體公司,沒視為純粹的「AI 基礎設施平台公司」。這種標籤嚴重壓抑了其估值天花板,使其無法享受到如 Nvidia 般的平台型公司溢價。

4. 對 Hyperscaler 基礎設施滲透率的懷疑

儘管 AMD 屢次宣布與 Microsoft、Meta、Oracle 等巨頭的合作,但市場長期懷疑這些合作的「含金量」。投資者擔憂,這些 Hyperscalers 只是拿 AMD 作為與 Nvidia 談判砍價的籌碼,不是真正將 AMD 的晶片作為核心基礎設施進行大規模部署。市場普遍認為,關鍵的核心 AI 工作負載,仍然牢牢掌握在 Nvidia 的 GPU 上,AMD 只是在一些邊緣或非核心應用中分到一杯羹。

為什麼這種認知在 2026 年開始崩解?

因為 AI 的應用場景發生了質變。當企業發現,單純的「Chatbot(聊天機器人)」無法帶來實質的生產力革命,他們開始轉向部署能夠自主執行任務的「AI Agents」。而這個轉變,精準地擊中了 CPU 的甜蜜點,也徹底撕裂了市場對 AMD 的舊有定價模型。市場意識到,AI 的未來是關於複雜系統協同與智能調度的革命,而這場革命的指揮官,正是 CPU。

二、Agentic AI 崛起:CPU 需求的拐點

雖然Moon在上月已經寫過關於CPU需求拐點的分析,但今天還是想再重寫一部分,也會加入一些新數據。

之前的分析在這裡:

簡單來說,這波敘事反轉的核心,在於理解「Agentic AI(代理式 AI)」究竟是什麼,以及它為何會從根本上改變 AI 伺服器的底層硬體架構和運算需求。

什麼是 Agentic AI?

Agentic AI 是一種能夠在極少人類干預下,自主處理廣泛任務的系統。它具備規劃、記憶、工具使用和自我反思的能力。過去的 AI 是「情境式」的:你輸入一個 Prompt,它吐出一段文字,運算就結束了。根據機構測算,這樣一次互動消耗大約 1,000 到 1,715 個 Tokens。

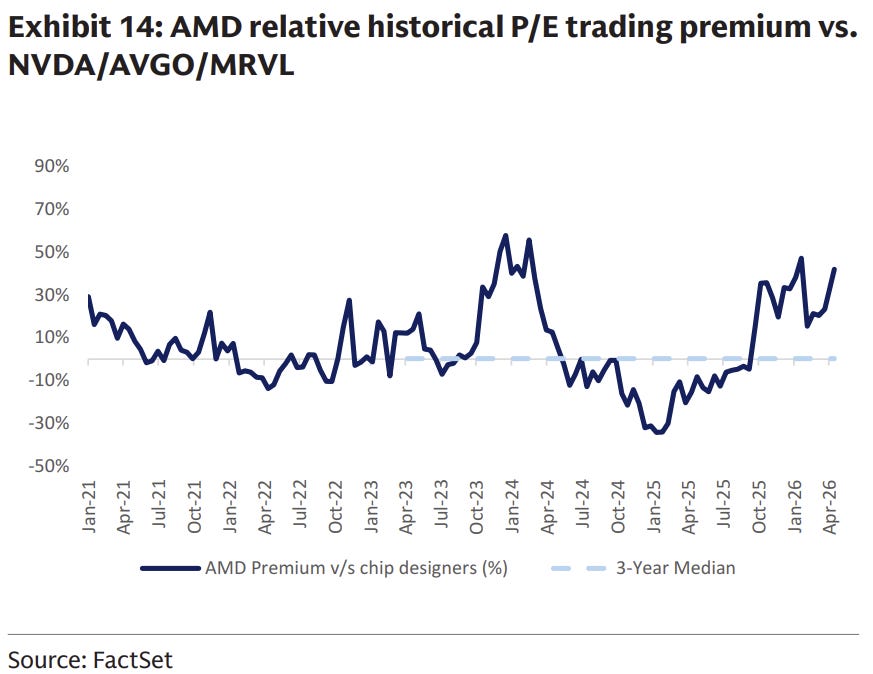

但 Agentic AI 是「持續性」與「多步迭代」的。一個企業級的「軟體工程師 Agent」或「資料輸入 Agent」,需要執行一個極其複雜的循環流程:

解析目標(Parsing intent): 理解高層次的模糊指令,如「幫我修復這個軟體 bug」。

加載系統上下文與架構(Loading context): 讀取數百萬行程式碼、API 文件和歷史紀錄。

規劃執行步驟(Planning): 將大任務分解成數十個甚至數百個可執行的小步驟。

調用外部工具(Tool calling): 頻繁地執行編譯器、調試器、版本控制系統、資料庫查詢等。

驗證與除錯(Validation & Debugging loops): 反覆運行測試、分析錯誤日誌、修改程式碼,形成一個不斷迭代的閉環。

更新系統狀態(Updating state): 將最終結果寫回系統,並更新自己的記憶,以便下次任務執行。

圖2:Agentic AI 的工作流程圖(Workflow Diagram),用戶從請求到 Agent 進行意圖解析、工具調用、多重迴圈驗證(Loops)到最終輸出的複雜過程。

機構數據顯示,這種工作模式對 Token 的消耗是指數級的。一個簡單的「資料輸入 Agent」每天可能消耗高達 2,500 萬個 Tokens,而一個「程式碼編寫 Agent」每天消耗約 700 萬個 Tokens。這與傳統 Chatbot 的千級 Token 消耗完全不在一個數量級。基於此,高盛預測,到 2030 年,Agentic AI 將推動全球 Token 消耗量暴增 24 倍(達到每月 120 萬億個 Tokens);而到 2040 年,企業級 Agent 將使 Token 消耗量提升驚人的 55 倍。

為什麼這會推高 CPU 需求?

在傳統的 LLM 訓練中,GPU 負責海量的平行矩陣乘法(Matrix Multiplication)。但在 Agentic AI 的推論(Inference)階段,工作負載的性質發生了劇變,大量任務從 GPU 轉移到了 CPU:

邏輯控制與路由(Routing & Orchestration): Agent 需要不斷在不同的微服務、API 和小型模型之間進行路由決策。例如,「如果 API 返回錯誤碼 404,則調用備用 API;如果用戶情緒為負面,則轉接人工客服」。這種高度依賴分支預測和序列邏輯的任務,正是現代 CPU 架構(如 AMD Zen 系列)的強項,GPU 處理起來反而效率極低。

工具調用與系統互操作性: 當 Agent 需要查詢 SQL 資料庫、執行一段 Python 腳本、或與企業舊有的 ERP 系統交互時,這些傳統的軟體堆疊完全是建立在 x86 CPU 架構之上的。AI Agent 必須通過 CPU 作為橋樑來與現實世界的數位基礎設施溝通。

上下文與記憶體管理: Agent 需要維護龐大的上下文視窗並頻繁讀寫系統記憶體。CPU 擁有更靈活、更複雜的記憶體層級架構(L1/L2/L3 Cache)和先進的記憶體控制器,能高效處理這些非結構化的資料流。

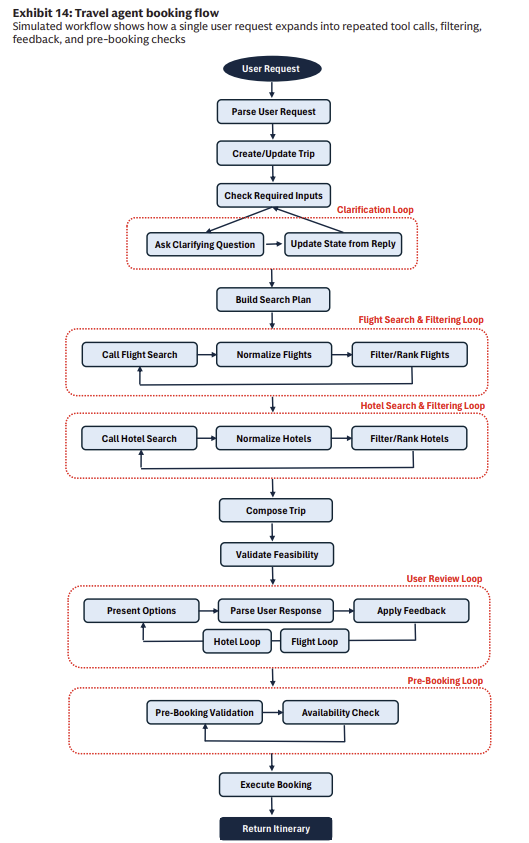

圖3: Inference 時代 CPU 的重要性大幅提升

這導致了一個極為關鍵的硬體架構轉變:AI 伺服器的 GPU:CPU 附加比例正在發生逆轉。 根據高盛的觀察,在最新的機架級(Rack-level)配置中,GPU 與 CPU 的比例已經從過去訓練時代的 8:1 轉變為推論時代的 2:1。業界甚至開始過渡到使用「純 CPU 機架」來輔助 GPU/ASIC 機架,專門處理龐大的 Agentic 協調工作。

三、為什麼 AMD 可能是最大的受惠者?

如果 CPU 需求爆發,為什麼是 AMD 而不是 Intel 或 ARM?

首先,企業級基礎設施的 x86 黏著度。儘管 ARM 架構在消費端(如手機)和 Hyperscaler 的內部工作負載(如 Google Search)中表現出色,但在企業級 Agentic AI 領域,x86 架構將保持絕對的多數市占率。原因在於,企業現有的 IT 基礎設施、資料庫、ERP 系統、虛擬化平台(VMware)幾乎全部基於 x86。AI Agent 需要與這些既有系統進行無縫的「互操作性(Interoperability)」,採用 x86 是阻力最小、成本最低、風險最小的路徑。

其次,AMD EPYC 處理器的絕對產品力優勢。在 Agentic AI 時代,伺服器需要更高的核心數(Higher Core Count)來處理多線程的 Agent 併發任務,同時需要極致的能源效率(Power Efficiency)來控制資料中心的總體擁有成本(TCO)。AMD 的 EPYC 處理器憑藉其 Chiplet 設計,在核心密度和每瓦效能上持續輾壓對手 Intel 的 Xeon。高盛預估,AMD 的伺服器 CPU 營收將在 2027 年達到 211 億美元,2028 年達到 274 億美元,分別高出華爾街共識預期 24% 與 38%。

從 Q1 2026 財報看市場認知的質變

讓我們回顧 AMD 2026 年第一季財報,數據本身會說話:

總營收: 102.5 億美元(擊敗華爾街預期的 98.9 億)

資料中心營收: 達到創紀錄的 57.7 億美元,年增長驚人,成為公司絕對的營收支柱

Q2 財測: 營收中位數 112 億美元,遠超華爾街預期的 105.3 億美元;非 GAAP 毛利率指引達 56%,顯示高利潤業務佔比持續提升

市場對這份財報反應如此強烈,不僅僅是因為「Beat and Raise」,更是因為營收結構的徹底翻轉。機構預測,到 2027 年,資料中心業務將佔 AMD 總營收的 75% 以上。過去拖累 AMD 估值的 PC(Client)、遊戲(Gaming)和嵌入式(Embedded)業務,其週期性波動已經被龐大的 AI 基礎設施需求完全掩蓋。AMD 展現出了強大的營運槓桿,伺服器 CPU 的高毛利正在實質性地推升整體的 EPS,使其盈利能力邁上一個全新的台階。

從AMD 的產品和技術理解它的價值重估

要完全理解 AMD 的價值重估,我們須深入其晶片架構的底層,探究其技術護城河的真正深度。

Infinity Fabric 4.0:機架級 AI 的神經網絡

在 Agentic AI 時代,單一節點的運算能力已不足夠,真正的挑戰在於如何將數百甚至數千個 GPU 和 CPU 高效地連接成一個統一的運算集群。這正是 AMD 的 Infinity Fabric 技術發揮關鍵作用的地方。最新的 Infinity Fabric 4.0 不僅僅是晶片內部的互連技術,它已經演進為一種機架級的交換架構。

它解決了兩個核心痛點:首先是 GPU 之間的點對點(P2P)通訊瓶頸。在複雜的多 Agent 協同任務中,不同的 GPU 可能需要頻繁交換中間結果和模型權重。Infinity Fabric 4.0 提供了遠超傳統 PCIe 的頻寬和更低的延遲,確保 GPU 集群不會因為通訊等待而閒置。其次,它實現了 CPU 和 GPU 之間的統一記憶體存取(Unified Memory),允許 CPU 直接讀寫 GPU 的 HBM 記憶體,反之亦然。這對於需要 CPU 進行大量資料預處理和後處理的 Agentic 工作流至關重要,極大地簡化了程式設計模型並提升了效率。

HBM4 的佈局:為萬億參數模型鋪路

記憶體頻寬是 AI 推論的生命線。隨著模型規模邁向萬億參數,對 HBM(高頻寬記憶體)的需求呈指數級增長。AMD 在其 GPU 路線圖中,對 HBM 的採用一直非常激進。即將推出的 MI350 系列將搭載 HBM3e,而備受期待的 MI400 系列(預計 2026-2027 年)將率先採用 HBM4 標準。

根據機構分析,HBM4 相較於 HBM3e 將帶來革命性的提升:頻寬預計從 ~8 TB/s 躍升至驚人的 19.6 TB/s,單顆 GPU 的記憶體容量也將從 288GB 提升至 432GB。然而,這也帶來了巨大的物理封裝和熱管理挑戰。HBM4 需要更寬的接口(2048-bit),這代表著晶片基板的設計將極其複雜。AMD 正在探索 3D 堆疊和混合鍵合(Hybrid Bonding)等先進封裝技術,以在有限的面積內容納更多的 HBM 堆疊。同時,超過 1500W 的 TDP(熱設計功耗)將迫使資料中心全面轉向液冷(Liquid Cooling)方案。AMD 在這方面的早期佈局和與生態夥伴的合作,將是其能否順利交付 MI400 的關鍵。

Zen 5 到 Zen 6:CPU 王座的持續鞏固

在 CPU 領域,AMD 的腳步從未停歇。EPYC “Turin” 處理器基於 Zen 5 架構,將核心數推向新的高峰(可能高達 192 核),並在 IPC(每時脈週期指令數)上實現了雙位數的增長。但市場更關注的是 Zen 6 架構的預期。

根據機構分析,Zen 6 將在以下幾個方面針對 Agentic AI 進行深度優化:

更先進的製程節點: 可能採用台積電的 2nm 或更先進的 GAA(Gate-All-Around)製程,以實現更高的電晶體密度和能效。

專用的 AI 加速單元: Zen 6 可能會整合專門用於處理低精度(如 INT4/INT8)推論和模型路由的 AI 引擎,將部分原本在 GPU 上運行的輕量級任務轉移到 CPU 中,進一步降低延遲。

記憶體與 I/O 的革命: 預計將支援 CXL 3.0 標準,允許 CPU、GPU 和其他加速器共享一個龐大的記憶體池,並支援 DDR6 記憶體,為處理海量上下文提供基礎。

四、機構視角:這波需求週期能走多遠?

對於機構投資者而言,最核心的問題是:Agentic AI 究竟是矽谷的又一次短期 Hype,還是一個具備長期可持續性的超級週期?

Token 經濟學的拐點:從「成本負擔」到「利潤擴張」

過去市場擔憂,AI 推論成本過高,Hyperscalers 的巨額 CapEx無法回收。但從機構的研究看來,Token 單位經濟效益正在改善。

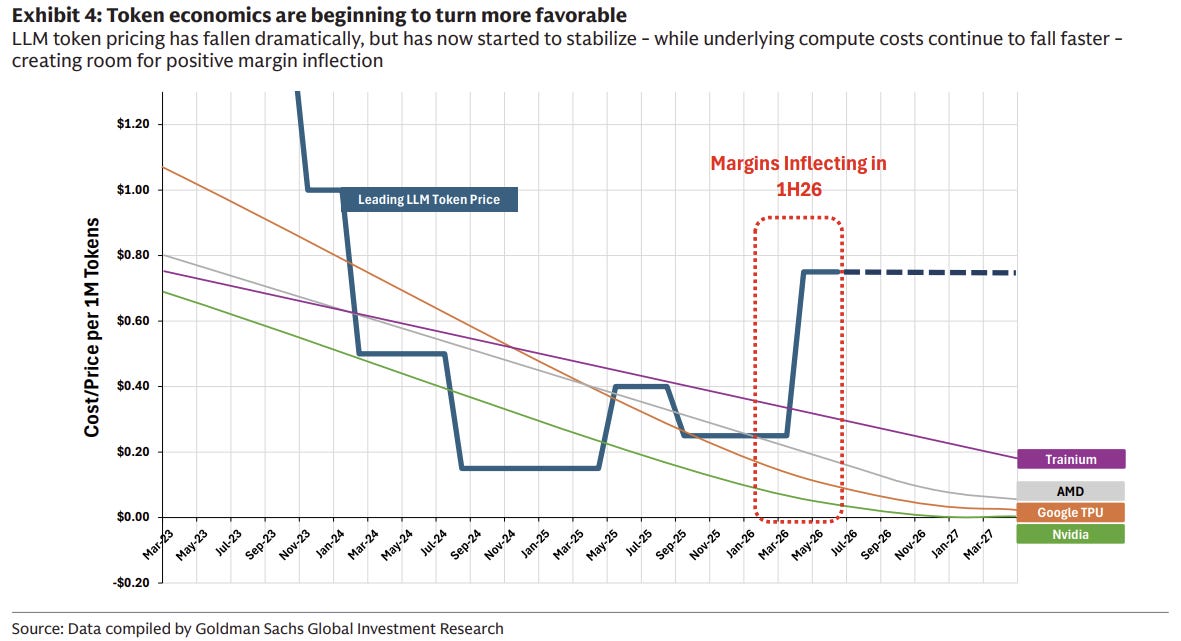

儘管領先 LLM 的 token 價格跌勢已開始放緩,甚至部分情況出現回升,但由 Nvidia、AMD、Google TPU、Trainium 等 AI 基礎設施推動的『每 token 運算成本』,仍正以年化約 60%-70% 的速度快速下降。這代表 AI 產業可能正進入 token economics 的利潤拐點。這意味著,Agentic AI 帶來的海量 Token 消耗,不再只是 Hyperscalers 的「成本負擔」,而是正在轉化為實質的「毛利擴張」。當基礎設施供應商開始賺錢,這波 CapEx 週期就有了堅實的商業邏輯支撐。

圖4:Token 經濟拐點, Token 價格企穩與底層運算成本持續下降的交叉曲線

企業級 AI 採用的 S 型曲線(S-Curve)

高盛透過歷史技術採用模型(如網際網路、雲端運算)分析指出,企業採用 Agentic AI 將呈現經典的「S 型曲線」。目前我們仍處於曲線的早期試驗階段,滲透率甚至不足 5%。高盛預測,到 2030 年,全球知識工作者的 Agent 採用率將達到 12%,而到 2040 年將達到 37% 的峰值。這代表著,這些 Agent 運行的底層 CPU 與 GPU 需求,擁有長達 10 到 15 年的長期增長跑道。

Datacenter GPU 的上修空間:Meta 6GW 部署的財務模擬

除了 CPU 的復興,我們也不能忽視 AMD 在 Datacenter GPU 領域的潛在爆發力。

目前機構目前最看好的假設之一,是 AMD 與 Meta 的 6GW GPU deployment opportunity。Meta 與 OpenAI 已與 AMD 建立戰略合作,並將 6GW GPU 部署納入長期模型之中。

高盛在模型中假設 AMD 的 Revenue/GW 約為 200 億美元,並預期隨著 AI cluster 規模與系統價值提升,未來仍有進一步上升空間。在這個 framework 下,高盛將 AMD Datacenter GPU revenue 預估上調至 2028年563 億美元,高於市場預期 26%。若 OpenAI deployment execution 更明確,或 Microsoft 對 AMD accelerator 的採用進一步提升,AMD Datacenter GPU revenue 仍有進一步上修空間。

至於Meta 為何願意承擔如此巨額的成本?答案在於其核心業務,廣告。Agentic AI 能夠極大地提升廣告系統的效率,包括更精準的用戶畫像、動態創意生成和廣告投放策略優化。如果這 6GW 的算力能夠使其廣告 ROAS(廣告支出回報率)提升僅僅 5%,對於 Meta 每年數千億美元的廣告收入而言,這將帶來數百億美元的額外營收,完全可以覆蓋其基礎設施投資。這也解釋了為何機構預估 AMD 的 Datacenter GPU 營收將在 2027 年達到 425 億美元,2028 年達到 563 億美元。

華爾街的共識與分歧

目前,華爾街機構對 AMD 的看法正在快速收斂,但仍存有細微分歧。Morgan Stanley 與 Bernstein 雖然也認同 Datacenter 的強勁增長,但部分分析師對 AMD GPU 軟體生態(ROCm)能否真正無縫替代 CUDA 抱持謹慎態度。然而,正如 JPMorgan 所指出的,當 Agentic AI 的瓶頸轉移到 CPU 協調與記憶體頻寬時,CUDA 的護城河效應正在被實質性地削弱。

五、潛在風險

AMD 仍面臨幾個不可忽視的客觀風險:

Agentic AI 企業採用率不如預期: 機構的模型建立在企業大規模部署 Agent 的假設上。然而,企業在資料治理、安全性、以及 ROI的考量下,可能會放緩部署速度。如果 Agentic AI 淪為雷聲大雨點小的概念,CPU 的需求爆發將大打折扣。

Meta 6GW 部署的執行風險: 如此龐大的基礎設施部署,面臨著供應鏈限制(如 CoWoS 封裝產能、HBM 記憶體供應)、電力與冷卻基礎設施的瓶頸。任何延遲都可能導致 AMD GPU 營收無法達標。

ARM 架構在企業端的逆襲: 雖然目前 x86 在企業端佔據絕對優勢,但如果 Nvidia 的 Grace CPU 或各大雲端廠商的自研 ARM 晶片(如 AWS Graviton、Google Axion)在軟體相容性上取得重大突破,可能會侵蝕 AMD EPYC 的長期市占率。

營運槓桿與毛利率壓力: 隨著競爭加劇,特別是如果 Nvidia 採取激進的定價策略來防守市占,AMD 可能需要增加研發與行銷支出,這將壓抑其毛利率擴張的速度。

結語

過去一個月 AMD 股價的狂飆,是因為市場對公司根本定位的重新定義:

AMD 正在從Nvidia 的 GPU 挑戰者,蛻變為Agentic AI 時代的核心運算基礎設施公司。

在生成式 AI 的第一階段(Training),Nvidia 憑藉 GPU 與 CUDA 建立了無可撼動的帝國。但隨著我們邁入第二階段(Agentic Inference),遊戲規則改變了。AI 不再只是單純的數學運算,而是複雜的邏輯路由、工具調用與系統協作。在這個新世界裡,CPU 不再是配角;x86 架構是企業無縫接軌 AI 的最強護城河。

AMD 憑藉著在伺服器 CPU(EPYC)的絕對統治力,加上在 Datacenter GPU 領域的強勢崛起(以 Meta 的 6GW 訂單為代表),成為了市場上唯一一家能夠同時提供頂級 CPU 與 GPU 完整解決方案的純硬體基礎設施巨頭。

Source: AMD, Goldman Sachs Research, J.P. Morgan Research, Morgan Stanley Research, Bernstein

免責聲明:本報告內容僅供學術探討與專業投資參考,不構成任何買賣證券的建議。投資者應基於自身的風險承受能力與獨立判斷做出投資決策。本報告所引用的投行數據與預測均基於公開可得之研究資料,此文不對其絕對準確性提供擔保。過往財務表現不代表未來收益保證。

作為每天都在打做ai 系統的pm , cpu 的重要性已是肉眼可見